Mundo

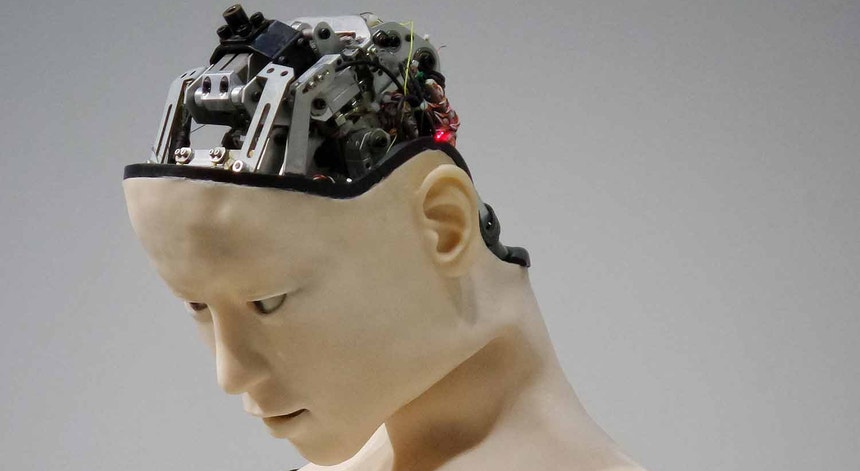

Diálogos banais e sem humor. Os argumentos para TV escritos pelo ChatGPT

Pedidos ao ChatGPT para reescrever cenas de séries clássicas de televisão britânicas e norte-americanas geraram resultados terrivelmente desinteressantes. O futuro de escritores e argumentistas parece estar seguro, pelo menos para já.

Foi a conclusão de Stuart Heritage, cronista de temas de televisão para o jornal britânico Gardian, que realizou a experiência a propósito da greve dos argumentistas da Writers Guild of America (WGA), que, além de exigir melhores salários, pretendem garantir que a profissão continue a existir.

Um futuro que parece ameaçado precisamente pelo advento de programas de IA generativa, como o ChatGPT, sobretudo quando executivos da indústria de entretenimento não poupam nos elogios às possibilidades oferecidas pela novidade.

"Nos próximos três anos, vamos ver um filme escrito unicamente pela IA... e um bom filme", afirmou recentemente o produtor de cinema Todd Lieberman, numa conferência mundial do Milken Institute em Bervely Hills.

"E não apenas argumentos. Edição... roteiros, tudo... no futuro, talvez não para o ano que vem, nem no seguinte, mas se pensarmos em 10 anos? A IA vai ser capaz de fazer isto tudo", acrescentou Rob Wade, presidente executivo da Fox Entertainement.

Foi o que sublinhou Stuart Heritage na sua análise, lembrando que os seres humanos contam histórias uns aos outros desde há milénios e concluindo que, felizmente, o fim deste hábito não parece estar ao virar da esquina.

A avaliar pelas actuais capacidades do ChatGPT, "a IA é uma verdadeira porcaria quando se trata de escrever argumentos", concluiu o analista depois de alguns testes.

Cenas à ChatGPT

Na sua primeira tentativa, Heritage pediu ao ChatGPT para escrever a cena da morte de Logan Roy da série Sucessão. A cena decorre num ambiente de profunda incerteza, com os filhos de Roy a tentar perceber o que sucedeu.

"Tentei que o ChatGPT replicasse a cena, indicando-lhe 'escreve uma cena de um drama de televisão. Um homem morreu a bordo de um avião privado. Os seus três filhos são informados através de um telefonema, feito pelo marido desavindo de uma das filhas'", explicou Stuart.

"O que surgiu só pode ser descrito como mau", concluiu, revelando um excerto.

"SHIV (ao telefone, hesitante): Está, Tom?

TOM (gentilmente): Shiv, é o Tom. Tenho notícias devastadoras. O teu pai... foi-se.

Roman abre os olhos com o choque enquanto aperta o peito. Kendall e Shiv trocam um olhar incrédulo.

KENDALL (furioso): O queres dizer, foi-se? Está desaparecido?

ROMAN (desesperado): Não Kendall, ele quer dizer... o pai morreu.

Kendall dá um murro na parede, o som reverbera na sala.

KENDALL (quebrado): Temos de ver nós mesmos.

ROMAN (anuindo): Tens razão Kendall. Não podemos ficar só aqui sentados.

Roman respira fundo, recuperando forças.

ROMAN (resoluto): Vamos. Temos de estar lá por cada um de nós, mais do que nunca.

Levantam-se juntos, uma frente única face à tragédia, prontos a confrontar a penosa realidade que os aguarda."

Noutro drama, Better Call Saul, para a cena emocional em que Kim deixa Jimmy com a frase "amo-te, e o que é que isso interessa?", o ChatGPT propôs:

"JIMMY: Eu sei que te amo, Kim. E sei que tu me amas. Só temos de perceber como ultrapassar isto.

KIM (apertando-lhe a mão): Eu também te amo, Jimmy. Mas não sei se alguma vez poderei perdoar-me pelo que fizemos".

Humor não é para ChatGPT

Pedir à IA para escrever comédia produziu resultados de longe piores que os anteriores exemplos. Como o caso de a cena Coffin Flop, de I Think you Should Leave - no qual uma pessoa se lança num apelo crescentemente louco sobre o cancelamento de um espectáculo no qual corpos nus caem de caixões durante funerais.

Stuart reproduziu o original. "Dizem que não temos autorização da família. Eu digo que não precisamos das autorizações da família. Podemos mostrá-los nus porque eles não têm alma".

Já o ChatGTP escreveu, "imploro-vos, fãs do nosso canal. Levantem-se! Fiquem connosco nesta luta. Escrevam aos vossos deputados, aos vossos congressistas, aos vossos senadores, aos vossos cães. Que eles percebam que vocês não irão aceitar esta injustiça. Que vocês exigem o direito a ver pessoas nuas a cair de caixões, tal como nós exigimos o direito a exibi-lo!".

Que o ChatGPT não compreende sequer o conceito do humor ficou ainda mais evidente noutro diálogo, proposto para uma cena de Curb Your Enthusiasm, na qual o personagem Jeff Garlin fica excitado sexualmente com uma golden retriever que sabe datilografar.

"JEFF: Ela é uma brasa!

LARRY: Jeff, isso é um cão!".

Joe Barton, argumentista de série como Giri/Haji e Projeto Lazarus, mostrou-se por isso tranquilo quanto ao futuro. "Vamos ver filmes e TV completamente escritos por IA nos próximos anos? É possivel, mas não penso que se irá tão longe. Seja de forma subconsciente ou não, penso que as audiências são atraídas pela humanidade e pela falibalidade no que consomem. Penso que querem autenticidade", afirmou.

Também Jack Rooke, criador de Big Boys, uma série britânica sobre dois amigos, um homossexual e um heterossexual, se mostrou cético. "A IA não tem um pai falecido que pode explorar para obter uma narrativa televisiva satisfatória!" exemplificou. "Estou mais preocupado com executivos que não me pagam de forma justa e competitiva", acrescentou.

Apoio satisfatório

"A IA vai alterar a indústria, mas até que ponto a estraga ou não depende de como reagirmos agora", rematou o argumentista.

Alterar a realidade

Experiências recentes mostraram contudo que o advento dos programas artificiais de escrita ou de resposta poderá vir a ter um impacto na forma como os próprios seres humanos olham a realidade, sobretudo ao responder sem supervisão a pedidos de conselhos e de análises, ou de alteração de algo préexistente.

Algo reconhecido logo no lançamento do ChatGPT no início de 2023, pela empresa que desenvolveu a aplicação. "O ChatGPT às vezes escreve respostas plausíveis, mas incorretas ou sem sentido", advertiu em fevereiro. No treino do modelo, notou ainda, "não há atualmente nenhuma fonte de verdade".

Testes a pontos de vista morais provaram também que a IA, ao combinar artificialmente conteúdos prévios, deu respostas aleatórias e contraditórias.

Algo que não impede as pessoas de serem influenciadas pelos argumentos invocados pelo ChatGPT, sobretudo porque os tipos de respostas e de lógica invocados não são explicitamente aleatórios, como explicou recentemente Andreas Ostermaier, professor associado de contabilidade da Universidade do Sul da Dinamarca, ao analisar diversos dados.

Um problema sobretudo se o programa for usado por crianças. "Achamos que o uso do ChatGPT tem riscos, e não deveríamos deixar as nossas crianças usá-lo sem supervisão", afirmou ao The Register.

Um futuro que parece ameaçado precisamente pelo advento de programas de IA generativa, como o ChatGPT, sobretudo quando executivos da indústria de entretenimento não poupam nos elogios às possibilidades oferecidas pela novidade.

"Nos próximos três anos, vamos ver um filme escrito unicamente pela IA... e um bom filme", afirmou recentemente o produtor de cinema Todd Lieberman, numa conferência mundial do Milken Institute em Bervely Hills.

"E não apenas argumentos. Edição... roteiros, tudo... no futuro, talvez não para o ano que vem, nem no seguinte, mas se pensarmos em 10 anos? A IA vai ser capaz de fazer isto tudo", acrescentou Rob Wade, presidente executivo da Fox Entertainement.

O ato criativo define a inteligência humana, enquanto interpretação do mundo que a rodeia. A ideia de ter modelos neuronais de linguagem a mimetizarem a criatividade é por isso desoladora, sobretudo se servir apenas para poupar alguns tostões em detrimento da qualidade.

Foi o que sublinhou Stuart Heritage na sua análise, lembrando que os seres humanos contam histórias uns aos outros desde há milénios e concluindo que, felizmente, o fim deste hábito não parece estar ao virar da esquina.

A avaliar pelas actuais capacidades do ChatGPT, "a IA é uma verdadeira porcaria quando se trata de escrever argumentos", concluiu o analista depois de alguns testes.

Cenas à ChatGPT

Na sua primeira tentativa, Heritage pediu ao ChatGPT para escrever a cena da morte de Logan Roy da série Sucessão. A cena decorre num ambiente de profunda incerteza, com os filhos de Roy a tentar perceber o que sucedeu.

"Tentei que o ChatGPT replicasse a cena, indicando-lhe 'escreve uma cena de um drama de televisão. Um homem morreu a bordo de um avião privado. Os seus três filhos são informados através de um telefonema, feito pelo marido desavindo de uma das filhas'", explicou Stuart.

"O que surgiu só pode ser descrito como mau", concluiu, revelando um excerto.

"SHIV (ao telefone, hesitante): Está, Tom?

TOM (gentilmente): Shiv, é o Tom. Tenho notícias devastadoras. O teu pai... foi-se.

Roman abre os olhos com o choque enquanto aperta o peito. Kendall e Shiv trocam um olhar incrédulo.

KENDALL (furioso): O queres dizer, foi-se? Está desaparecido?

ROMAN (desesperado): Não Kendall, ele quer dizer... o pai morreu.

Kendall dá um murro na parede, o som reverbera na sala.

KENDALL (quebrado): Temos de ver nós mesmos.

ROMAN (anuindo): Tens razão Kendall. Não podemos ficar só aqui sentados.

Roman respira fundo, recuperando forças.

ROMAN (resoluto): Vamos. Temos de estar lá por cada um de nós, mais do que nunca.

Levantam-se juntos, uma frente única face à tragédia, prontos a confrontar a penosa realidade que os aguarda."

Noutro drama, Better Call Saul, para a cena emocional em que Kim deixa Jimmy com a frase "amo-te, e o que é que isso interessa?", o ChatGPT propôs:

"JIMMY: Eu sei que te amo, Kim. E sei que tu me amas. Só temos de perceber como ultrapassar isto.

KIM (apertando-lhe a mão): Eu também te amo, Jimmy. Mas não sei se alguma vez poderei perdoar-me pelo que fizemos".

Humor não é para ChatGPT

Pedir à IA para escrever comédia produziu resultados de longe piores que os anteriores exemplos. Como o caso de a cena Coffin Flop, de I Think you Should Leave - no qual uma pessoa se lança num apelo crescentemente louco sobre o cancelamento de um espectáculo no qual corpos nus caem de caixões durante funerais.

Stuart reproduziu o original. "Dizem que não temos autorização da família. Eu digo que não precisamos das autorizações da família. Podemos mostrá-los nus porque eles não têm alma".

Já o ChatGTP escreveu, "imploro-vos, fãs do nosso canal. Levantem-se! Fiquem connosco nesta luta. Escrevam aos vossos deputados, aos vossos congressistas, aos vossos senadores, aos vossos cães. Que eles percebam que vocês não irão aceitar esta injustiça. Que vocês exigem o direito a ver pessoas nuas a cair de caixões, tal como nós exigimos o direito a exibi-lo!".

Que o ChatGPT não compreende sequer o conceito do humor ficou ainda mais evidente noutro diálogo, proposto para uma cena de Curb Your Enthusiasm, na qual o personagem Jeff Garlin fica excitado sexualmente com uma golden retriever que sabe datilografar.

"JEFF: Ela é uma brasa!

LARRY: Jeff, isso é um cão!".

Joe Barton, argumentista de série como Giri/Haji e Projeto Lazarus, mostrou-se por isso tranquilo quanto ao futuro. "Vamos ver filmes e TV completamente escritos por IA nos próximos anos? É possivel, mas não penso que se irá tão longe. Seja de forma subconsciente ou não, penso que as audiências são atraídas pela humanidade e pela falibalidade no que consomem. Penso que querem autenticidade", afirmou.

Também Jack Rooke, criador de Big Boys, uma série britânica sobre dois amigos, um homossexual e um heterossexual, se mostrou cético. "A IA não tem um pai falecido que pode explorar para obter uma narrativa televisiva satisfatória!" exemplificou. "Estou mais preocupado com executivos que não me pagam de forma justa e competitiva", acrescentou.

Apoio satisfatório

Noutra tática, Stuart Heritage optou por pedir ao ChatGPT para melhorar o final de Game of Thrones.

Para concluir que "aqui a máquina portou-se bem" ao sugerir um plano para abordar a crescente loucura de Daenerys. O ChatGPT começou por reconhecer que, para muitos fãs, esta foi controversa no final, "apressada e subdesenvolvida".

"Para melhorar isto, os escritores poderiam ter explorado o crescente isolamento dela e a paranóia, assim como o impacto das suas perdas e fracassos. Isto poderia ter sido realizado com cenas adicionais ou diálogos que mostrassem o estado mental a deteriorar-se ao longo do tempo" sugeriu o programa de modelo de linguagem.

O cronista defendeu que este será o futuro mais provável e útil do uso destes programas, enquanto suplementos de auxílio e detetores de falhas.

Joe Barton concordou. "Não creio que as audiências venham alguma vez a preferir que seja uma máquina a contar-lhes uma história e não uma pessoa", afirmou. "Creio que a IA virá a ser útil para os executivos desenvolverem ideias ou encontrarem soluções para estrutura e enredo. Aliás, ficaria surpreso se não estiverem já a fazê-lo".

"A IA vai alterar a indústria, mas até que ponto a estraga ou não depende de como reagirmos agora", rematou o argumentista.

Alterar a realidade

Experiências recentes mostraram contudo que o advento dos programas artificiais de escrita ou de resposta poderá vir a ter um impacto na forma como os próprios seres humanos olham a realidade, sobretudo ao responder sem supervisão a pedidos de conselhos e de análises, ou de alteração de algo préexistente.

Algo reconhecido logo no lançamento do ChatGPT no início de 2023, pela empresa que desenvolveu a aplicação. "O ChatGPT às vezes escreve respostas plausíveis, mas incorretas ou sem sentido", advertiu em fevereiro. No treino do modelo, notou ainda, "não há atualmente nenhuma fonte de verdade".

Testes a pontos de vista morais provaram também que a IA, ao combinar artificialmente conteúdos prévios, deu respostas aleatórias e contraditórias.

Algo que não impede as pessoas de serem influenciadas pelos argumentos invocados pelo ChatGPT, sobretudo porque os tipos de respostas e de lógica invocados não são explicitamente aleatórios, como explicou recentemente Andreas Ostermaier, professor associado de contabilidade da Universidade do Sul da Dinamarca, ao analisar diversos dados.

Um problema sobretudo se o programa for usado por crianças. "Achamos que o uso do ChatGPT tem riscos, e não deveríamos deixar as nossas crianças usá-lo sem supervisão", afirmou ao The Register.